Burza po zdjęciu z bydgoskiego SOR-u. Pacjentów diagnozował chatGPT?

Zdjęcie jednej kartki z polskiego SOR-u wystarczyło, by wywołać ogólnopolską burzę i uruchomić lawinę pytań o to, jak dziś naprawdę wygląda leczenie pacjentów. Internauci natychmiast wychwycili fragment dokumentu, który do złudzenia przypomina komunikat znany z ChatGPT. Czy lekarze zaczęli korzystać ze sztucznej inteligencji przy tworzeniu dokumentacji medycznej? A jeśli tak – gdzie kończy się pomoc technologii, a zaczyna ryzyko dla pacjentów? Sprawa z Bydgoszczy pokazuje coś więcej niż jeden incydent – odsłania problem, który może dotyczyć całego systemu.

- Czy dokument ze szpitala naprawdę zawiera fragment wygenerowany przez ChatGPT i co dokładnie zauważyli internauci?

- Jakie mogą być konsekwencje używania sztucznej inteligencji w dokumentacji medycznej pacjentów w Polsce?

- Dlaczego sprawa z SOR w Bydgoszczy wywołała tak duże emocje i podzieliła opinię publiczną?

- Czy lekarze mogą legalnie korzystać z AI przy opisywaniu wizyt i gdzie przebiega granica odpowiedzialności?

- Co ta sytuacja mówi o stanie ochrony zdrowia i rosnącej roli nowych technologii w pracy lekarzy?

Co dokładnie pokazuje dokument ze szpitala w Bydgoszczy?

Sprawa zaczęła się od zdjęcia karty informacyjnej z izby przyjęć Wojewódzkiego Szpitala Dziecięcego w Bydgoszczy, które trafiło do mediów społecznościowych. Na pierwszy rzut oka dokument wygląda standardowo – zawiera opis wywiadu, przebieg wizyty oraz zalecenia dla pacjenta.

Kontrowersje wzbudził jednak jeden fragment, który wyraźnie odbiega od typowego języka medycznego. Chodzi o zdanie sugerujące możliwość przygotowania „pełniejszego wywiadu”, charakterystyczne raczej dla komunikacji znanej z narzędzi opartych na sztucznej inteligencji.

Do sprawy odniósł się również Paweł Usiądek, wiceprezes Ruchu Narodowego i lider Konfederacji w okręgu płocko-ciechanowskim. W swoim wpisie w mediach społecznościowych nie szczędził gorzkich słów pod adresem systemu ochrony zdrowia.

„Może i lekarze dostają spore podwyżki, NFZ nie leczy, ale przynajmniej jak leczą, to z pomocą darmowego ChatGPT” – napisał.

Jego komentarz szybko zyskał popularność w sieci i stał się jednym z najczęściej przywoływanych głosów w dyskusji. Wpis wpisuje się w szerszą krytykę funkcjonowania publicznej ochrony zdrowia i rosnącej roli nowych technologii w pracy lekarzy.

To właśnie ten element sprawił, że internauci zaczęli spekulować, czy dokument mógł powstać przy wsparciu ChatGPT. Na tym etapie nie ma jednak jednoznacznego potwierdzenia, w jaki sposób wpis został przygotowany. Sam screen nie rozstrzyga, czy mamy do czynienia z użyciem AI, błędem czy innym źródłem tekstu.

Czy lekarz może korzystać ze sztucznej inteligencji przy tworzeniu dokumentacji?

Pojawiające się wątpliwości szybko prowadzą do szerszego pytania: czy lekarz w ogóle może korzystać z narzędzi takich jak ChatGPT przy tworzeniu dokumentacji medycznej. W praktyce przepisy nie odnoszą się wprost do konkretnych technologii, ale jasno określają jedną zasadę – za treść dokumentu zawsze odpowiada lekarz.

Oznacza to, że nawet jeśli w procesie powstawania opisu wykorzystano narzędzie cyfrowe, to podpisujący dokument specjalista bierze pełną odpowiedzialność za jego poprawność i zgodność ze stanem faktycznym.

Według tych danych, technologia może wspierać pracę – np. porządkować informacje czy pomagać w redakcji – ale nie może zastępować badania pacjenta ani decyzji klinicznych. Ryzyko pojawia się wtedy, gdy gotowe, wygenerowane treści trafiają do dokumentacji bez dokładnej weryfikacji.

Internauci podzieleni. Jedni widzą narzędzie, inni poważny problem

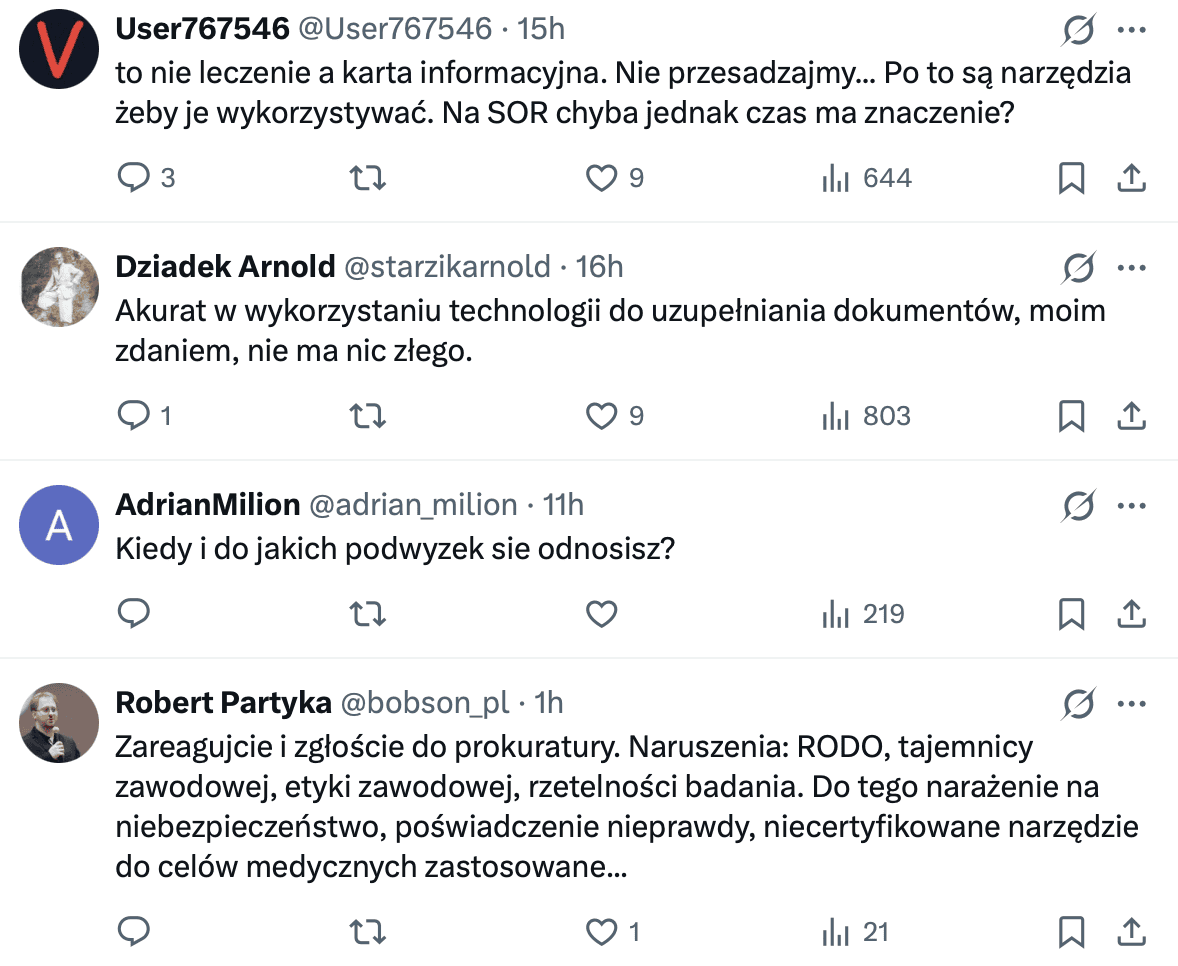

Dyskusja wokół sprawy bardzo szybko przeniosła się do internetu i wyraźnie podzieliła opinię publiczną. Część komentujących nie widzi w sytuacji nic nadzwyczajnego i zwraca uwagę na realia pracy lekarzy, szczególnie na SOR-ach, gdzie liczy się czas.

„To nie leczenie a karta informacyjna. Nie przesadzajmy… Po to są narzędzia żeby je wykorzystywać. Na SOR chyba jednak czas ma znaczenie?” – pisze jeden z użytkowników.

Podobne głosy wskazują, że wykorzystanie technologii do tworzenia dokumentów może być naturalnym kierunkiem rozwoju.

Z drugiej strony pojawiają się zdecydowanie ostrzejsze reakcje. Część internautów zwraca uwagę na kwestie rzetelności, bezpieczeństwa danych i odpowiedzialności zawodowej.

„Zareagujcie i zgłoście do prokuratury. Naruszenia: RODO, tajemnicy zawodowej, etyki zawodowej” – czytamy w jednym z komentarzy.

Spór pokazuje, że problem wykracza poza jeden przypadek i dotyka szerszego pytania o miejsce sztucznej inteligencji w zawodach zaufania publicznego.

Coraz trudniej odróżnić, co napisał człowiek, a co sztuczna inteligencja

Sprawa z Bydgoszczy wpisuje się w szerszy trend, który coraz częściej zauważają zarówno eksperci, jak i zwykli użytkownicy internetu. W 2026 roku granica między treścią stworzoną przez człowieka, a wygenerowaną przez sztuczną inteligencję zaczyna się zacierać.

To widać także w reakcjach na opublikowaną kartę informacyjną. Część internautów nie tylko analizuje jej treść, ale wręcz podważa autentyczność samego dokumentu.

Problem wykracza poza jedną sytuację. Nawet jeśli dokument jest prawdziwy, sama możliwość, że mógł zostać wygenerowany lub zmodyfikowany przez AI, wystarcza, by wywołać wątpliwości.

W praktyce oznacza to jedno: zaufanie do treści – także tych oficjalnych – zaczyna się kruszyć. A w przypadku dokumentacji medycznej to szczególnie wrażliwy obszar.

Dlatego dziś ważniejsze niż kiedykolwiek stają się przejrzystość i odpowiedzialność. Bo w świecie, w którym technologia potrafi pisać jak człowiek, to człowiek musi wziąć pełną odpowiedzialność za to, co podpisuje.

Źródło: Goniec